🎯 Réponse Rapide et Points Clés :

Un LLM (Large Language Model) est un système d’IA entraîné sur des milliards de textes pour comprendre et générer du langage humain. Ces réseaux neuronaux profonds utilisent l’architecture Transformer pour analyser le contexte et prédire les mots suivants avec précision.

Les points essentiels :

– Les LLM contiennent généralement plus d’un milliard de paramètres ajustables

– Ils fonctionnent par prédiction de jetons (tokens) basée sur des probabilités statistiques

– Leurs applications vont des chatbots à la génération de code en passant par l’analyse de sentiments

Qu’est-ce qu’un Grand Modèle de Langage ?

Les grands modèles de langage représentent une évolution majeure dans le traitement automatique du langage naturel. Concrètement, un LLM analyse des volumes massifs de données textuelles pour apprendre les structures linguistiques, le contexte et les nuances du langage humain.

Définition technique

Un LLM se définit par trois caractéristiques fondamentales :

- Volume de paramètres : Généralement au-delà du milliard de paramètres ajustables

- Architecture neuronale : Réseaux de neurones profonds basés sur l’apprentissage automatique

- Capacité prédictive : Génération de texte cohérent par analyse contextuelle

Ces modèles ne « comprennent » pas le langage comme un humain. Ils identifient des patterns statistiques dans les données d’entraînement pour prédire quel mot, ou jeton, a le plus de chances d’apparaître ensuite.

Les composants d’un LLM

L’architecture repose sur plusieurs couches interconnectées :

Tokenisation : Le texte est découpé en unités élémentaires (mots, sous-mots ou caractères). Cette étape transforme le langage humain en données exploitables par le modèle.

Embeddings : Chaque jeton reçoit une représentation vectorielle numérique qui capture sa signification sémantique dans un espace multidimensionnel.

Couches d’attention : Le mécanisme d’attention permet au modèle de pondérer l’importance de chaque mot en fonction du contexte. C’est le cœur de l’architecture Transformer introduite en 2018.

Couches de transformation : Des réseaux neuronaux profonds traitent ces informations à travers des dizaines, voire des centaines de couches successives.

L’Architecture Transformer : La Révolution de 2018

L’article fondateur « Attention is All You Need », publié par huit chercheurs de Google en 2018, a bouleversé le domaine. Cette architecture a remplacé les modèles récurrents traditionnels par un mécanisme d’attention parallèle bien plus performant.

Le mécanisme d’attention

L’attention permet au modèle d’identifier quels mots d’une phrase influencent le sens d’un mot cible. Prenons l’exemple : « La banque du fleuve était verdoyante, contrairement à la banque où je travaille. »

Le modèle comprend que « banque » a deux significations différentes grâce aux mots environnants (« fleuve » vs « travaille »). Cette capacité contextuelle distingue les LLM des anciens systèmes de traitement du langage.

Pourquoi cette architecture domine

Les Transformers présentent trois avantages décisifs :

- Parallélisation : Traitement simultané de tous les mots, accélérant drastiquement l’entraînement

- Contexte étendu : Capacité à analyser des séquences très longues (plusieurs milliers de jetons)

- Scalabilité : Performance qui s’améliore proportionnellement à l’augmentation des données et paramètres

💬 Notre analyse : L’architecture Transformer n’est pas qu’une amélioration incrémentale. Elle a rendu possible l’émergence de capacités jusqu’alors inaccessibles, comme la génération de texte cohérent sur plusieurs paragraphes ou la traduction contextuelle nuancée. Sans cette innovation, les LLM actuels n’existeraient tout simplement pas sous leur forme moderne.

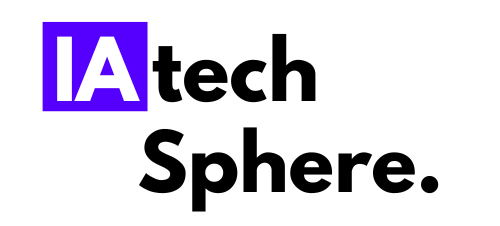

Comment les LLM Sont-ils Entraînés ?

L’entraînement d’un LLM se déroule en plusieurs phases distinctes, chacune requérant des ressources computationnelles considérables.

Pré-entraînement : La Phase Fondamentale

Cette étape initiale consiste à exposer le modèle à des ensembles de données textuelles massifs. On parle de centaines de milliards, voire de trillions de jetons provenant de :

- Pages web publiques

- Livres numérisés

- Articles scientifiques

- Code source

- Conversations en ligne

Le modèle apprend de manière non supervisée, c’est-à-dire sans étiquetage humain. L’objectif : prédire le mot suivant dans une phrase. Simple en apparence, cette tâche force le modèle à internaliser grammaire, vocabulaire, structures logiques et connaissances factuelles.

Apprentissage supervisé : L’Ajustement Fin

Après le pré-entraînement, le modèle générique subit un fine-tuning sur des tâches spécifiques. Cette phase utilise des données étiquetées par des humains pour affiner les performances sur des cas d’usage précis :

- Classification de sentiments

- Réponse à des questions

- Résumé de texte

- Traduction

Le volume de données nécessaire est bien moindre que pour le pré-entraînement, mais la qualité des annotations devient critique.

Apprentissage par Renforcement à Partir de Retours Humains (RLHF)

Technique popularisée par OpenAI avec ChatGPT, le RLHF affine le comportement du modèle selon les préférences humaines. Le processus :

- Le modèle génère plusieurs réponses à une même requête

- Des évaluateurs humains classent ces réponses par ordre de préférence

- Un modèle de récompense apprend à prédire les préférences humaines

- Le LLM s’ajuste pour maximiser cette fonction de récompense

Cette approche améliore la pertinence, réduit les réponses toxiques et aligne le modèle sur les attentes utilisateurs.

Les Principaux LLM qui Dominent en 2026

Le paysage des grands modèles de langage se structure autour de quelques acteurs majeurs, chacun avec ses spécificités techniques et philosophiques.

GPT (OpenAI)

La série GPT (Generative Pre-trained Transformer) a popularisé les LLM auprès du grand public. Lancée en 2018 avec GPT-1, elle a connu plusieurs itérations majeures :

GPT-2 (2019) : 1,5 milliard de paramètres. OpenAI avait initialement retardé sa publication publique, craignant des usages malveillants.

GPT-3 (2020) : 175 milliards de paramètres. Premier modèle démontrant des capacités de « few-shot learning » (apprentissage à partir de quelques exemples seulement).

GPT-4 (2023) : Architecture multimodale traitant texte et images. Performances significativement améliorées en raisonnement complexe et fiabilité factuelle.

Claude (Anthropic)

Développé par d’anciens chercheurs d’OpenAI, Claude se distingue par son approche « Constitutional AI » axée sur la sécurité. Le modèle est entraîné avec des principes éthiques explicites guidant ses réponses.

Points forts :

- Fenêtre contextuelle étendue (jusqu’à 200 000 jetons)

- Refus proactif de générer du contenu problématique

- Performances excellentes en analyse de documents longs

Gemini (Google DeepMind)

Successeur de BARD, Gemini intègre nativement capacités textuelles, visuelles et auditives. Google capitalise sur son infrastructure cloud et ses décennies de recherche en IA pour proposer un modèle profondément intégré à son écosystème.

LLaMA (Meta)

Meta a adopté une stratégie d’ouverture avec LLaMA (Large Language Model Meta AI). Publié en 2023, ce modèle open-source a démocratisé l’accès aux LLM performants pour la recherche académique et les développeurs.

LLaMA 2 et ses variantes ont permis l’émergence d’une communauté active créant des versions spécialisées (médecine, droit, code).

Mistral (Mistral AI)

Startup française fondée par d’anciens chercheurs de Google et Meta, Mistral AI propose des modèles optimisés pour l’efficacité. Leur approche : performances comparables aux géants américains avec des modèles plus légers et moins coûteux à opérer.

Mistral 7B et Mixtral 8x7B (architecture « mixture of experts ») ont démontré qu’innovation et efficience peuvent coexister.

Applications Concrètes des LLM

Les grands modèles de langage transforment de nombreux secteurs. Voici les cas d’usage les plus impactants.

Assistants Conversationnels et Chatbots

Les LLM alimentent la nouvelle génération de chatbots capables de conversations naturelles et contextuelles. Contrairement aux systèmes à base de règles, ils comprennent les nuances, gèrent l’ambiguïté et maintiennent la cohérence sur de longs échanges.

Applications :

- Support client automatisé disponible 24/7

- Assistants personnels (planification, recherche d’information)

- Compagnons d’apprentissage adaptatifs

Génération et Optimisation de Contenu

Les créateurs de contenu utilisent les LLM pour :

- Rédiger des brouillons d’articles, emails, rapports

- Générer des variations de textes marketing

- Adapter le ton et le style selon l’audience

- Créer des scripts vidéo ou des dialogues

Important : ces outils assistent la création, ils ne remplacent pas le jugement éditorial et la vérification factuelle humaine.

Analyse de Sentiments et Compréhension Client

Les entreprises exploitent les LLM pour analyser massivement les retours clients :

- Classification automatique des avis (positif/négatif/neutre)

- Détection des thèmes récurrents dans les feedbacks

- Identification proactive des clients insatisfaits

- Analyse des tendances émotionnelles sur les réseaux sociaux

Cette compréhension fine permet d’ajuster produits et services en temps réel.

Développement Logiciel

Les LLM révolutionnent la programmation :

- Génération de code à partir de descriptions en langage naturel

- Détection et correction de bugs

- Explication de code existant

- Suggestion d’optimisations

GitHub Copilot, basé sur GPT, assiste des millions de développeurs quotidiennement. Attention toutefois : le code généré nécessite toujours une revue humaine rigoureuse.

Traduction et Localisation

Les LLM surpassent les systèmes de traduction statistique traditionnels en capturant :

- Les nuances culturelles

- Les expressions idiomatiques

- Le contexte conversationnel

- Les variations de registre (formel/informel)

Ils permettent des traductions plus naturelles et contextuellement appropriées.

Recherche et Synthèse d’Information

Les moteurs de recherche intègrent progressivement les LLM pour :

- Comprendre l’intention derrière les requêtes complexes

- Générer des résumés synthétiques de multiples sources

- Répondre directement aux questions factuelles

- Suggérer des questions de suivi pertinentes

Cette évolution transforme la recherche d’information d’une liste de liens vers des réponses directes et contextualisées.

Avantages et Limites des LLM

Comme toute technologie, les grands modèles de langage présentent des forces remarquables et des faiblesses structurelles à comprendre.

Les Avantages Majeurs

Polyvalence exceptionnelle : Un seul modèle peut accomplir des dizaines de tâches différentes sans réentraînement spécifique. Cette généralisation était impossible avec les systèmes précédents.

Apprentissage par contexte : Les LLM peuvent s’adapter à de nouvelles tâches simplement en recevant quelques exemples dans la requête (few-shot learning). Pas besoin de réentraînement coûteux.

Compréhension contextuelle : Capacité à maintenir la cohérence sur de longues conversations et à interpréter les ambiguïtés selon le contexte.

Amélioration continue : Les performances s’accroissent avec l’augmentation des données, des paramètres et de la puissance de calcul. Cette scalabilité prévisible guide les investissements R&D.

Les Limites Structurelles

Hallucinations factuelles : Les LLM génèrent parfois des informations fausses mais plausibles. Ils optimisent la vraisemblance linguistique, pas la véracité. Un LLM peut affirmer avec assurance des faits inventés.

Biais hérités des données : Si les données d’entraînement contiennent des biais (sexistes, racistes, culturels), le modèle les reproduira. Les efforts de débiaisage sont complexes et jamais totalement efficaces.

Manque de raisonnement causal : Les LLM excellent en reconnaissance de patterns, mais peinent sur le raisonnement logique complexe ou les problèmes nécessitant une compréhension causale profonde.

Coût computationnel : L’entraînement d’un LLM de pointe coûte des millions de dollars en infrastructure. L’inférence (génération de réponses) consomme également des ressources significatives, limitant l’accessibilité.

Absence de connaissances actualisées : Un LLM ne « sait » que ce qui figurait dans ses données d’entraînement. Sans mécanisme de mise à jour, ses connaissances deviennent obsolètes.

Vulnérabilité aux attaques adversariales : Des requêtes spécialement conçues peuvent contourner les garde-fous et faire générer du contenu inapproprié ou biaisé.

Optimisation des Requêtes : Le Prompt Engineering

Obtenir des résultats optimaux d’un LLM nécessite de maîtriser l’art de la formulation des requêtes, appelé « prompt engineering ».

Principes de Base

Clarté et spécificité : Plus votre requête est précise, meilleure sera la réponse. Remplacez « Parle-moi de Python » par « Explique les différences entre listes et tuples en Python avec des exemples de code ».

Contexte suffisant : Fournissez les informations nécessaires. « Rédige un email à mon client » donnera un résultat générique. « Rédige un email à mon client Jean Dupont pour reporter notre réunion du 15 mars au 22 mars en raison d’un conflit d’agenda » sera bien plus efficace.

Format attendu : Spécifiez la structure souhaitée. « Liste à puces », « paragraphe de 100 mots », « tableau comparatif » orientent le modèle.

Techniques Avancées

Few-shot prompting : Donnez quelques exemples du résultat attendu avant votre requête réelle. Le modèle inférera le pattern et l’appliquera.

Chain-of-thought : Demandez au modèle d’expliciter son raisonnement étape par étape. Pour des problèmes complexes, ajoutez « Explique ton raisonnement avant de répondre ».

Role prompting : Assignez un rôle au modèle. « Tu es un expert en cybersécurité. Analyse cette configuration réseau… » améliore souvent la pertinence technique.

Contraintes explicites : Précisez ce que vous ne voulez pas. « Réponds sans utiliser de jargon technique » ou « Limite ta réponse à 200 mots ».

Erreurs Courantes à Éviter

Ne supposez pas que le modèle « comprend » l’implicite. Ce qui est évident pour vous ne l’est pas nécessairement pour un système statistique.

Évitez les requêtes trop ouvertes qui mènent à des réponses vagues et génériques.

N’enchaînez pas trop de demandes dans une seule requête. Décomposez en étapes successives pour de meilleurs résultats.

Considérations Éthiques et Enjeux Sociétaux

L’adoption massive des LLM soulève des questions éthiques et sociétales majeures.

Désinformation et Manipulation

Les LLM peuvent générer du contenu persuasif à grande échelle. Cette capacité facilite la création de fausses informations, de deepfakes textuels ou de campagnes de manipulation d’opinion.

Les plateformes et régulateurs explorent des solutions : watermarking (marquage invisible du contenu généré), détecteurs de texte IA, régulation des usages malveillants.

Protection de la Vie Privée

Les LLM sont entraînés sur des données publiques qui peuvent contenir des informations personnelles. Des cas de mémorisation involontaire de données sensibles ont été documentés.

Les développeurs implémentent des techniques de « machine unlearning » pour effacer sélectivement certaines informations, mais c’est un défi technique majeur.

Impact sur l’Emploi

Les LLM automatisent certaines tâches intellectuelles (rédaction, traduction, code simple). Cela transforme le marché du travail.

Plutôt qu’un remplacement pur, on observe surtout une évolution des compétences requises. Les professionnels qui maîtrisent ces outils deviennent plus productifs. L’enjeu : formation et adaptation des travailleurs.

Concentration du Pouvoir

L’entraînement de LLM de pointe requiert des ressources colossales, limitant leur développement à quelques géants technologiques. Cette concentration pose des questions de gouvernance et de contrôle démocratique de technologies influentes.

Les initiatives open-source (LLaMA, Mistral, Bloom) tentent de démocratiser l’accès, mais l’écart de ressources reste considérable.

Empreinte Environnementale

L’entraînement d’un grand modèle consomme autant d’énergie qu’une ville moyenne pendant plusieurs jours. L’empreinte carbone de l’IA devient un enjeu environnemental significatif.

Les chercheurs travaillent sur des architectures plus efficientes et l’utilisation d’énergies renouvelables pour les datacenters.

L’Avenir des LLM : Tendances et Évolutions

Le domaine des grands modèles de langage évolue à vitesse fulgurante. Plusieurs directions se dessinent.

Multimodalité Native

Les futurs LLM intégreront nativement texte, image, audio et vidéo. Cette convergence permettra des interactions plus riches et naturelles. Gemini et GPT-4 ont initié cette tendance, qui va s’amplifier.

Modèles Spécialisés

Plutôt que des modèles généralistes toujours plus gros, on voit émerger des LLM spécialisés par domaine (médecine, droit, finance). Ces modèles plus petits mais ultra-performants sur leur niche offrent un meilleur rapport efficacité/coût.

Raisonnement Amélioré

Les recherches actuelles visent à doter les LLM de véritables capacités de raisonnement logique et causal, au-delà de la reconnaissance de patterns. Les architectures hybrides combinant LLM et systèmes symboliques sont prometteuses.

Personnalisation et Mémoire

Les LLM futurs maintiendront une mémoire à long terme des interactions avec chaque utilisateur, permettant une personnalisation profonde tout en respectant la vie privée.

Efficience Énergétique

La pression environnementale et économique pousse vers des architectures plus légères. Les techniques de compression (quantification, distillation) permettent de réduire drastiquement la taille des modèles sans perte significative de performance.

Vérifiabilité et Traçabilité

Les LLM intégreront des mécanismes de citation de sources et de traçabilité du raisonnement, répondant au problème des hallucinations et renforçant la confiance.

Conclusion

Les grands modèles de langage représentent une avancée technologique majeure qui transforme notre rapport à l’information et à l’automatisation des tâches intellectuelles. Leur architecture Transformer, leur capacité d’apprentissage à partir de données massives et leur polyvalence en font des outils puissants pour de nombreuses applications. Cependant, leurs limites structurelles — hallucinations, biais, coûts computationnels — exigent une utilisation critique et informée.

Contrairement aux conclusions concurrentes qui se concentrent sur l’adoption généralisée, l’enjeu central en 2026 reste la littératie en IA : comprendre ce que les LLM peuvent et ne peuvent pas faire, maîtriser le prompt engineering et développer un esprit critique face aux contenus générés. Les organisations qui investissent dans la formation de leurs équipes à ces compétences, plutôt que dans le simple déploiement d’outils, créent un avantage compétitif durable.

Prochaine étape : Expérimentez avec différents LLM (GPT, Claude, Mistral) pour identifier leurs forces respectives selon vos cas d’usage. Documentez vos prompts efficaces et affinez-les itérativement. La maîtrise pratique vaut mieux que la compréhension théorique.